![]()

Contenu : |

Multimédia et bases de données Spécificité des données multimédias Spécificité des outils et des méthodes de développement Spécificité des outils de traitement |

Le mot multimédia est maintenant couramment employé comme adjectif. On se demande alors pourquoi on écrit encore "base de données multimédia" alors qu'il est clair que ce sont les données qui sont multimédias. Pour notre part, nous accorderons le mot multimédia avec le mot données et on écrira "base de données multimédias".

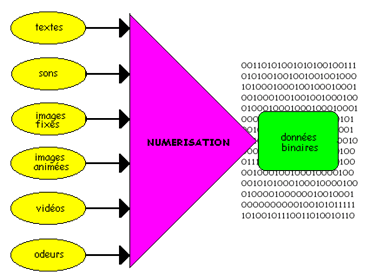

Ceci étant, qu'est-ce qu'une donnée multimédia ? C'est une donnée qui appartient à plusieurs formats d'information :

L'ensemble conjugué de ces différentes données, pour une diffusion vers des utilisateurs, s'appelle…le multimédia. Il possède des spécificités fortes que nous résumons plus loin (il s'agit d'un résumé certainement pas exhaustif).

La problématique des bases de données multimédias est aisément compréhensible si l'on prend l'exemple illustratif suivant. Un hold up a lieu dans une banque et la police recherche activement les voleurs. Pour cela elle dispose

Tous ces documents sont volumineux et "manuellement" la police va mettre beaucoup de temps pour rechercher les corrélations possibles permettant d'identifier les voleurs. Il faut donc

Sur ce dernier point il y a une énorme différence entre une requête du type "Rechercher l'adresse de la personne de nom 'Dupont' " et la requête "Rechercher 'Dupont' sur la photographie X". On conçoit que pour que la deuxième requête aboutisse, il est indispensable d'indexer l'image photographique X.

Le multimédia est l'intégration au sein d'un même système d'information de données textuelles, d'images fixes ou animées, de sons, de vidéo. Son histoire est très récente, depuis 1990 environ, et va de pair avec la tendance prononcée à la numérisation de l'information, la production de petits systèmes informatiques à possibilités très performantes et au développement de l'interconnexion de réseaux, notamment dans ce dernier cas, Internet et sa composante "multimédia" : le World Wide Web.

Selon les points de vue, le multimédia recouvre un marché en pleine expansion, un environnement de travail et de loisir (les jeux vidéo !), des applications professionnelles ou grand public, une industrie portant sur la production de matériels et logiciels. Une définition possible est celle-ci (selon Terrasson) : le multimédia est l'exploitation simultanée de données sonores, visuelles, informatiques, l'ensemble des techniques de création, de stockage, de transmission, de restitution, et aussi l'ensemble des données permettant cette exploitation simultanée.

Un premier intérêt du multimédia est l'intégration généralisée des données et des outils de manipulation de ces données. Avant le multimédia, des appareillages divers étaient nécessaires : un ordinateur pour les données informatiques, un magnétophone pour les cassettes de sons, un magnétoscope pour les vidéos, un téléphone pour le transport de la voix, du papier pour les images, …L'utilisation simultanée de données de natures différentes nécessitait donc une juxtaposition inconfortable de ces outils. L'utilisation de l'ordinateur comme outil unique est un progrès sensible.

Par ailleurs, les données multimédias sont manipulées comme des données informatiques puisque codées sous forme de 0 et de 1 et peuvent donc, en particulier, être stockées de manière unique et transmises de manière unique ce qui constitue un second intérêt

Cette intégration se fait cependant avec quelques problèmes :

Néanmoins cette tendance semble irréversible et entraîne une reconfiguration du paysage autrefois audio-visuel en paysage totalement numérique.

La plupart des informations sont distribuées sous forme de textes, d'images fixes, de sons, de vidéo. Actuellement, il est possible de numériser ces médias (il n'est cependant pas encore possible de numériser les odeurs (sauf appareillages particuliers), les goûts et les sensations de toucher).

Les textes

Composés de caractères dits d'imprimerie, la numérisation s'opère simplement par codage de chaque caractère en une suite de 0 et de 1. Le code ASCII (American Standard Code for Information Interchange) sur 7 bits permet de coder 128 caractères usuels. Comme les ordinateurs travaillent usuellement sur des mots qui sont des multiples de mots de 8 bits (octets), on peut rajouter un 0 devant le code ASCII, ce qui correspond au code normalisé. Ainsi le caractère "A" est codé 01000010. On peut aussi rajouter un 1 et définir un second jeu de 128 caractères (code ASCII étendu) ; malheureusement ce second jeu n'est pas normalisé et varie d'une plate forme informatique à l'autre.

Il est également possible de coder la mise en forme du texte : gras, italique, souligné, la taille des caractères, l'alignement, etc. Là encore, il n'y a pas de normalisation et les logiciels manipulant du texte possèdent encore leur propre système.

Pour un texte comportant 2000 caractères (espaces compris), sans style, la taille du fichier numérisé sera donc de 2000 octets ce qui correspond à un volume faible. Le livre numérique des "Trois mousquetaires" d'Alexandre Dumas correspond à un ficher de 1371 Ko (abu.cnam.fr).

Cependant, l'ASCII est bien insuffisant pour coder tous les signes utilisés sur la planète (caractères chinois, arabes, arméniens, latins, bengalis, Braille, cherokees, etc.). Un code universel a donc été inventé : l'Unicode dont les caractères sont représentés par 16 bits ce qui donne 216 possibilités, soit 65536 possibilités (pas mal, non ?). De plus l'Unicode englobe l'ASCII. Mais l'inconvénient est justement la longueur du code (2 octets) alors que l'ASCII ne prenait qu'un seul octet. Si on considère un grand texte en français codé en Unicode il prendra le double de volume de sa version codée en ASCII. Mais il y a une solution : l'UTF-8. Cette solution consiste à utiliser l'ASCII (sur un octet par caractère) pour les caractères "anglophones" et utiliser Unicode seulement pour les caractères spéciaux (é, à, ê, ….) en prévenant évidemment que l'on a affaire à un caractère spécial. Cette méthode réduit très sensiblement les volumes de données. Aujourd'hui UTF-8 est lisble par tous les (bons) navigateurs.

Les images fixes

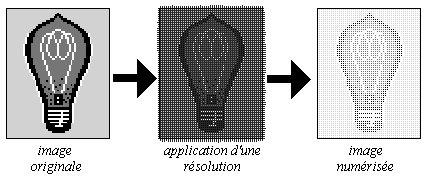

Pour les applications multimédias, les images sont converties en matrices de points. Chaque point est codé suivant sa "couleur" et les codes résultants sont placés séquentiellement dans un fichier, ligne par ligne, colonne par colonne.

Pour une image binaire, c'est à dire "bicolore", noir et blanc, chaque point est codé sur 2 bits (0 pour noir, 1 pour blanc. Pour une image avec 256 nuances de gris allant du noir total au blanc total, chaque point sera codé sur 8 bits (de 00000000 pour noir à 11111111 pour blanc). Pour une image couleur, on exprime cette couleur comme une superposition d'une dose de Rouge, d'une dose de Vert et d'une dose de Bleu (système RVB) ; si on permet une variation de 0 à 255 pour une dose, une couleur quelconque sera codée comme la juxtaposition de trois octets, soit 24 bits (et donc 16 777 216 couleurs possibles).

Considérons une image pour laquelle la grille de codage se compose de 640*480 points. Si l'image est binaire, sa taille est de 38 400 octets, si l'image est à 256 nuances de gris, sa taille est de 307 200 octets ; si l'image possède des couleurs codées sur 24 bits, sa taille est de 921 600 octets. Si l'on considère qu'une vieille disquette 3p1/2 contient usuellement 1 400 000 octets, on comprend que ce support est quelque peu limité pour le stockage de nombreuses images. Par ailleurs, des techniques de compression permettent de gagner de la place mais au prix d'une décompression au moment de l'affichage des images ; ce que l'on gagne en volume est perdu en vitesse d'affichage.

La taille du fichier obtenu après numérisation et avant compression est fortement influencée par le pas de la grille de codage qui est appelé résolution et exprimé usuellement en points par pouce (dpi : dots per inch). Pour une même image une résolution de 600 dpi donnera un fichier image 36 fois plus volumineux que le fichier image résultant d'une numérisation à 100 dpi.

Les techniques de compression conduisent à des formats d'images, soit normalisés, soit imposés par les industriels. Trois formats d'image sont couramment employés pour les applications multimédias en ligne :

Ces trois formats ont l'immense avantage d'être interprétés par la plupart des navigateurs du Web.

Les sons

Les technologies d'acquisition du son ont été longtemps analogiques : le son était représenté par les variations d'une grandeur physique, une tension électrique par exemple. Les techniques actuelles permettent d'obtenir directement un son numérisé : c'est notamment le cas des magnétophones produisant un enregistrement sur cassettes D.A.T. (Digital Audio Tapes, digitalisation du son à une fréquence de 48 KHz) .

Pour numériser un son enregistré de manière analogique, on procède en trois étapes :

On comprendra que les valeurs de f et de n sont critiques pour la taille du fichier résultant. Usuellement 3 qualités de numérisation sont employées :

Le volume d'un fichier son est alors donné par la relation

V = f x t x n x p

où f est la fréquence d'échantillonnage (en Hz), t la durée du son (en secondes), n le nombre de bits de codage d'un échantillon, p le nombre de piste (p = 1 pour un son mono, 2 pour un son stéréo, 4 pour un son quadriphonique) et V le volume du fichier (en bits).

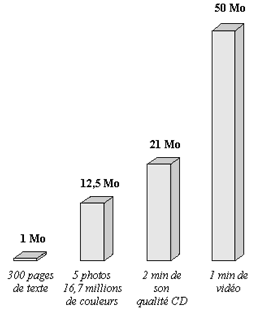

Ainsi, 1 heure de son correspondra à des fichiers de 630 Mo, 158 Mo et 40 Mo pour les qualités CD, radio et téléphonique respectivement. Nous verrons plus loin que les standards de CD ROM correspondent à une capacité d'environ 640 Mo et que les DVD vont jusqu'à 8,5 Go.

Les normes de codage numérique du son portent sur l'enregistrement non compressé des mesures quantifiées (PCM : Pulse Code Modulation), sur l'enregistrement des différences entre deux mesures successives, ce qui permet une réduction de volume de données (DPCM : Delta PCM), ou encore sur l'utilisation de techniques de prédiction des mesures (ADPCM : Adaptative Differential PCM).

Etant donné les volumes importants que présentent les fichiers son, il est quasiment impératif de compresser ces fichiers. Parmi les formats de compression, le format MP3 (« MPEG-1 Audio layer 3 ») est le plus populaire. Il emploie une méthode avec perte de données car il élimine les fréquences inaudibles pour l'oreille humaine et peut remplacer deux signaux voisins par un seul signal.

La vidéo

Comme pour le son, la vidéo s'exprime par des signaux de nature analogique qu'il faut numériser pour une utilisation multimédia. Il existe ici quatre signaux à numériser : trois pour l'image et un pour le son. Les signaux d'image se répartissent en signal de luminance Y et deux signaux de chrominance Db et Dr, reliés aux composantes R,V,B (Rouge, Vert, Bleu) par les relations linéaires

Y = 0.30R + 0.59V + 0.11B

Db = B - Y

Dr = R - Y.

La composante Y est échantillonnée à une fréquence de 13,5 MHz, tandis que les composantes de chrominance sont échantillonnées à une fréquence de 6,75 MHz. La quantification pour les trois signaux d'image s'opère sur 8 bits.

Les données peuvent être simultanément ou ultérieurement compressées. Plusieurs systèmes sont actuellement utilisés. La compression Indéo d'Intel est utilisée dans le logiciel Vidéo For Windows (le résultat de la numérisation et de la compression conduit à des fichiers vidéo AVI). Pour des plates-formes Macintosh, mais aussi Windows, le logiciel Quick Time d'Apple joue un rôle analogue à partir de fichiers vidéo MOOV ; un grand intérêt de Quick Time est sa possibilité d'intégration de données initiales diverses (images, sons, textes) et de proposer plusieurs types de compression. Les logiciels Video For Windows et Quick Time réalisent également la synchronisation du son avec les images.

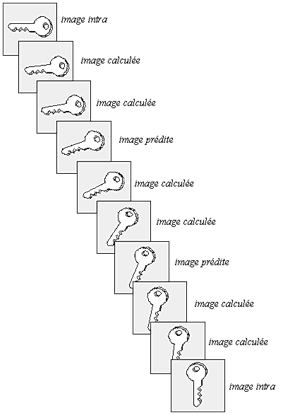

Les standards MPEG (toute une série), spécialement élaborés pour la compression de vidéo, tendent à s'imposer. Le principe de compression s'appuie sur trois types d'images : les images "intra" sont des images peu compressées qui servent de repère (une image intra pour 10 images successives) ; les images "prédites" sont des images obtenues par codage et compression des différences avec les images intra ou prédites précédentes (une image prédite toutes les trois images) ; les images "interpolées" sont calculées comme images intermédiaires entre les précédentes. L'utilisation de vidéos numériques MPEG nécessite la présence d'une carte de décompression dans le micro-ordinateur d'exploitation.

Un des standards MPEG mérite notre attention pour la suite : le standard MPEG-7 (qui porte aussi le nom de Multimedia Content Description Interface) qui permet de rendre possible une recherche d'informations dans un flux vidéo.

Les supports des données ou des applications multimédia doivent satisfaire deux contraintes essentielles :

Les supports classiques que sont les disquettes 1,4 Mo sont évidemment à éliminer du fait de leur faible capacité. Les disques durs magnétiques pourraient être de bons candidats pour l'hébergement d'une application multimédia de taille raisonnable ; en particulier, leur débit d'entrée/sortie est satisfaisant ; mais leurs coûts et leurs technologies qui les rendent indissociables de l'ordinateur (peu adapté au stockage) les éliminent, quant il s'agit de supports de diffusion commerciale, au profit de la famille des CD-ROM qui, née avec le multimédia, est actuellement, avec les DVD-ROM, le support quasi-universel des applications et des données multimédias distribués off line.

Par contre, pour des applications mettant en jeu des bases de données, accessibles en local ou à distance, l'utilisation des disques durs est encore la meilleure solution, sauf, peut-être, pour des données dont les modifications sont rares ; dans ce dernier cas, l'utilisation de dispositifs de type juke-box de CD-ROM/DVD-ROM peut être une solution.

Le développement d'une application multimédia implique des outils spécifiques adaptés au type des données à traiter ou à leur intégration.

Les outils qui sont liés au type de donnée sont

Suivant les cas, ces outils sont des composants matériels et/ou logiciels.

Les outils d'intégration sont logiciels et correspondent soit à la structuration des données, soit à leur manipulation et en particulier à la réalisation de l'interface utilisateur. Les outils de structuration des données sont principalement des systèmes de gestion de bases de données dotés d'extensions permettant la gestion de données multimédias. Les outils de manipulation peuvent être des langages auteurs orientés multimédias (ils réalisent alors directement l'intégration de données multimédias de types différents) ou des langages de programmation usuels (c'est au programmeur de réaliser tous les traitements).

Le multimédia nécessite, pour son exploitation, des ressources supplémentaires par rapport à celles des ordinateurs classiques. La station multimédia est un ordinateur, le plus souvent micro-ordinateur, doté

Heureusement ces ressources se sont généralisées et les micro-ordinateurs du marché sont de plus en plus multimédias dans leur configuration de base et les prix continuent de baisser pour la quasi-totalité des constructeurs. En fait, il semble que les smartphones et tablettes graphiques soient bien en avance sur les ordinateurs portables classiques.

Bien entendu, ces considérations ne s'appliquent qu'aux "postes" d'exploitation ; les dispositifs de stockage et de diffusion que constituent les serveurs peuvent être, au contraire, d'une très grande complexité technique et d'un coût nettement plus important.

Dans le domaine du multimédia, on parle souvent d'applications "on line" et d'application "off line" pour indiquer que l'exploitation des données multimédias s'effectue en connexion avec un réseau informatique ou en local sans réseau. Plus précisément, ces deux modes d'exploitation correspondent aux deux modes de diffusion actuels que sont la diffusion par CD-ROM/DVD-ROM et la diffusion par le World Wide Web.

Le CD-ROM est le moyen de stockage le plus pratique pour le multimédia et son utilisation première a été pour l'enregistrement du son sur le CD Audio en remplacement du disque vinyle. D'une capacité globale de 640 Mo, le CD-ROM permet l'enregistrement de 200 000 pages de texte brut, ou de 2000 images en 256 couleurs, ou de 250 images en 16 millions de couleurs, ou de 12 minutes de vidéo, ou de 60 minutes de son, ou, bien sûr, un mixage de différents médias. Ces chiffres montrent à la fois les avantages et les inconvénients du CD-ROM : sa capacité est grande mais ses limites sont vite atteintes. L'apparition du DVD (Digital Versatile Disk) permet de multiplier par 10 les capacités de stockage ; et prend peu à peu la place des "bons vieux CD".

L'autre mode de diffusion consiste en la composante interactive d'Internet : le Web. Basé sur une architecture de type client-serveur ce service assure la délivrance par un serveur sur un poste client de documents multimédias encodés par un langage de description appelé HTML (HyperText Mark up Language). Ces documents HTML sont interprétés par un logiciel spécifique, le navigateur, installé sur le poste client. Le navigateur (browser, en anglais) permet la communication avec le serveur et l'affichage du document. Le protocole HTTP (HyperText Transfer Protocol) qui régit les communications entre le serveur et le client est l'outil de base pour la diffusion sur réseau de documents multimédias. On connaît le succès de cette technologie (de 12 millions d'internautes en France en 2001 à 49 millions en 2012 soit 71,6% des Français de 11 ans et plus selon Médiamétrie).

Choisir la bonne réponse dans les questions suivantes. Une bonne réponse rapporte 1 point, une mauvaise - 1 point. Le choix d'une réponse n'est pas obligatoire. Il peut y avoir plusieurs bonnes réponses.